Los investigadores de Stanford y Google DeepMind han creado una IA que puede replicar personalidades humanas con una precisión asombrosa después de solo una conversación de dos horas.

Al entrevistar a 1.052 personas de diversos orígenes, construyeron lo que llaman “agentes de simulación”: copias digitales que eran espeluznantemente efectivas para predecir las creencias, actitudes y comportamientos de sus homólogos humanos.

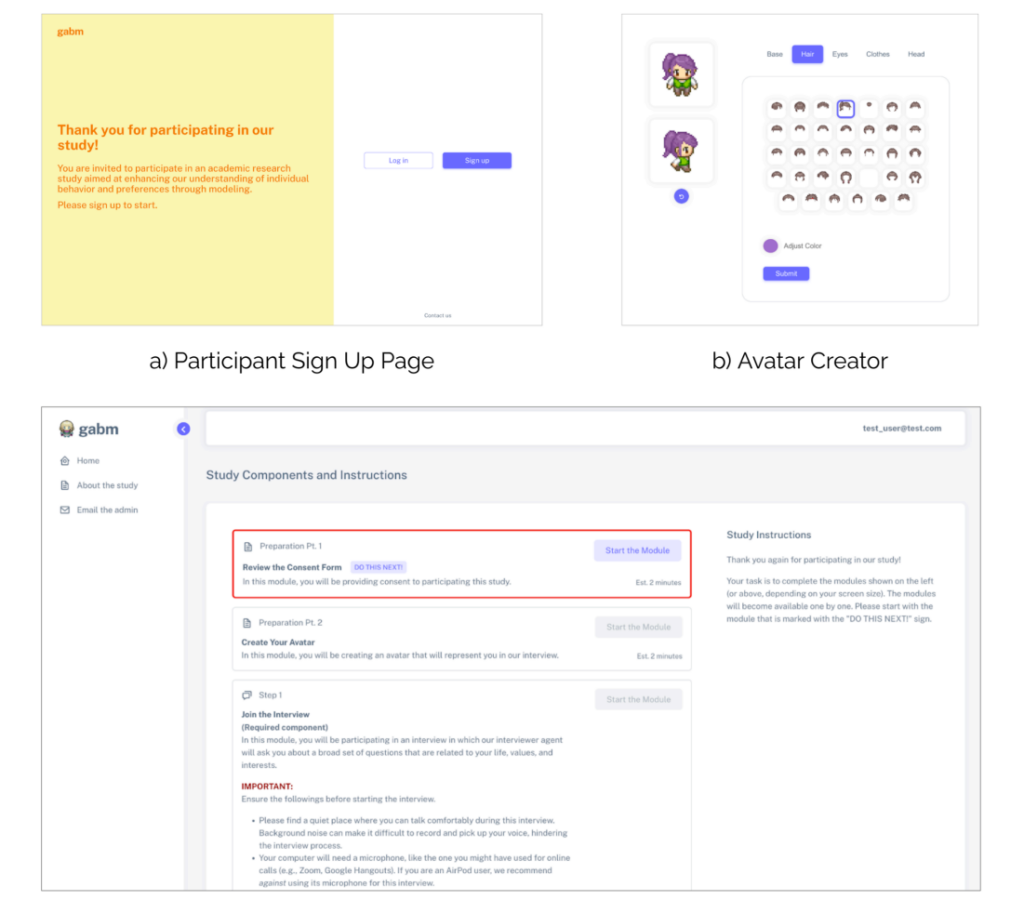

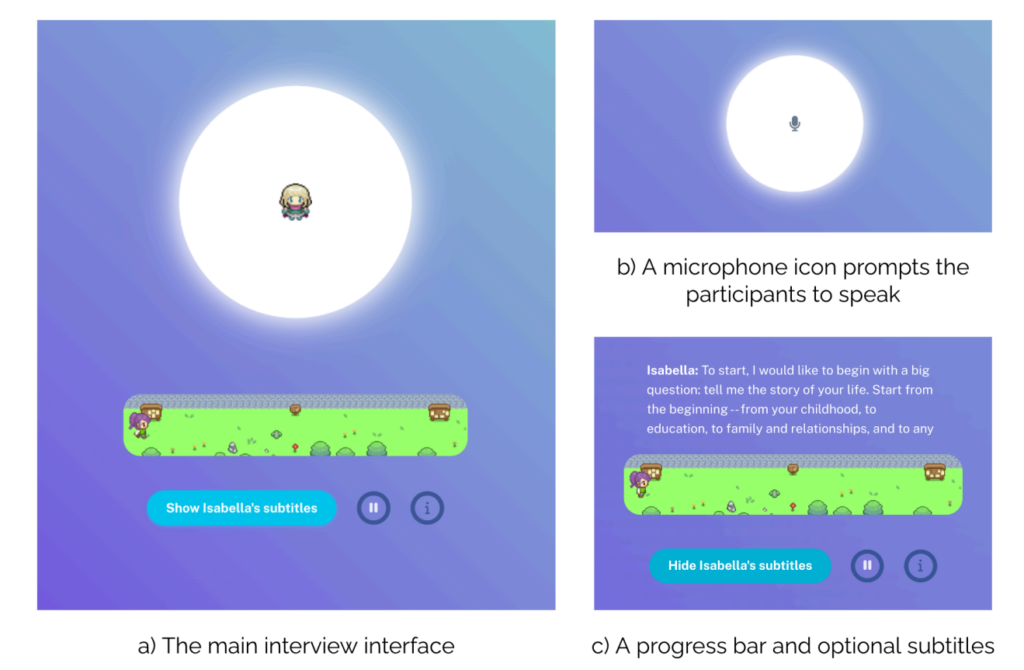

Para crear las copias digitales, el equipo utiliza datos de un “entrevistador de IA” diseñado para involucrar a los participantes en una conversación natural.

El entrevistador de IA hace preguntas y genera preguntas de seguimiento personalizadas (un promedio de 82 por sesión) explorando todo, desde recuerdos de la infancia hasta opiniones políticas.

A través de estas discusiones de dos horas, cada participante generó transcripciones detalladas con un promedio de 6500 palabras.

Por ejemplo, cuando un participante menciona la ciudad natal de su infancia, la IA podría profundizar más y preguntar sobre recuerdos o experiencias específicas. Al simular un flujo natural de conversación, el sistema captura información personal matizada que las encuestas estándar tienden a pasar por alto.

Detrás de escena, el estudiar documenta lo que los investigadores llaman “reflexión de expertos”, lo que incita a grandes modelos de lenguaje (LLM) a analizar cada conversación desde cuatro puntos de vista profesionales distintos:

- Como psicólogo, identifica rasgos de personalidad y patrones emocionales específicos; por ejemplo, observa cómo alguien valora la independencia basándose en sus descripciones de las relaciones familiares.

- A través de la lente de un economista conductual, extrae conocimientos sobre la toma de decisiones financieras y la tolerancia al riesgo, como cómo abordan los ahorros o las elecciones profesionales.

- La perspectiva del politólogo mapea las inclinaciones ideológicas y las preferencias políticas en diversos temas.

- Un análisis demográfico captura factores socioeconómicos y circunstancias de vida.

Los investigadores concluyeron que esta técnica basada en entrevistas superó a métodos comparables, como la extracción de datos de las redes sociales, por un margen sustancial.

Probando las copias digitales

Entonces, ¿qué tan buenas eran las copias de IA? Los investigadores los sometieron a una serie de pruebas para averiguarlo.

Primero, utilizaron la Encuesta Social General, una medida de actitudes sociales que plantea preguntas sobre todo, desde opiniones políticas hasta creencias religiosas. Aquí, las copias de IA coincidieron con las respuestas de sus homólogos humanos el 85% de las veces.

En la prueba de personalidad de los Cinco Grandes, que mide rasgos como la apertura y la escrupulosidad a través de 44 preguntas diferentes, las predicciones de la IA se alinearon con las respuestas humanas aproximadamente el 80% de las veces. El sistema fue excelente para capturar rasgos como la extraversión y el neuroticismo.

Sin embargo, las pruebas de juegos económicos revelaron limitaciones fascinantes. En el “Juego del Dictador”, donde los participantes deciden cómo dividir el dinero con otros, la IA tuvo dificultades para predecir perfectamente la generosidad humana.

En el “Juego de la Confianza”, que pone a prueba la voluntad de cooperar con otros para beneficio mutuo, las copias digitales sólo coincidieron con las elecciones humanas alrededor de dos tercios de las veces.

Esto sugiere que, si bien la IA puede captar nuestros valores declarados, todavía no puede captar plenamente los matices de la toma de decisiones sociales humanas (todavía, por supuesto).

Experimentos del mundo real

Sin detenerse ahí, los investigadores también sometieron las copias a cinco experimentos clásicos de psicología social.

En un experimento que probó cómo la intención percibida afecta la culpa, tanto los humanos como sus copias de IA mostraron patrones similares de asignar más culpa cuando las acciones dañinas parecían intencionales.

Otro experimento examinó cómo la justicia influye en las respuestas emocionales, con copias de IA que predicen con precisión las reacciones humanas ante un trato justo o injusto.

Las réplicas de IA reprodujeron con éxito el comportamiento humano en cuatro de cinco experimentos, lo que sugiere que pueden modelar no sólo respuestas tópicas individuales sino patrones de comportamiento amplios y complejos.

Clones fáciles de IA: ¿Cuáles son las implicaciones?

Los sistemas de IA que “clonan” opiniones y comportamientos humanos son un gran negocio, con Meta anunció recientemente planes para llenar Facebook e Instagram con perfiles AI que pueden crear contenido e interactuar con los usuarios.

TikTok también saltó a la palestra con su nuevo conjunto “Symphony” de herramientas creativas impulsadas por inteligencia artificial, que incluye avatares digitales que las marcas y los creadores pueden utilizar para producir contenido localizado a escala.

Con Symphony Digital Avatars, TikTok permite a los creadores elegibles crear avatares que representen a personas reales, con una amplia gama de gestos, expresiones, edades, nacionalidades e idiomas.

La investigación de Stanford y DeepMind sugiere que dichas réplicas digitales serán mucho más sofisticadas y más fáciles de construir e implementar a escala.

“Si puedes tener un grupo de pequeños ‘tú’ corriendo y tomando las decisiones que tú habrías tomado, creo que eso es, en última instancia, el futuro”, dijo el investigador principal Joon Sung Park, estudiante de doctorado en ciencias de la computación de Stanford. describe a CON.

Park describe que esta tecnología tiene ventajas, ya que la construcción de clones precisos podría respaldar la investigación científica.

En lugar de realizar experimentos costosos o éticamente cuestionables con personas reales, los investigadores podrían probar cómo las poblaciones podrían responder a ciertos estímulos. Por ejemplo, podría ayudar a predecir reacciones a mensajes de salud pública o estudiar cómo las comunidades se adaptan a cambios sociales importantes.

Sin embargo, en última instancia, las mismas características que hacen que estas réplicas de IA sean valiosas para la investigación también las convierten en poderosas herramientas para el engaño.

A medida que las copias digitales se vuelven más convincentes, distinguir la interacción humana auténtica de la IA se ha vuelto difícil, como hemos observado en una avalancha de falsificaciones profundas.

¿Qué pasaría si esa tecnología se utilizara para clonar a alguien en contra de su voluntad? ¿Cuáles son las implicaciones de crear copias digitales modeladas intencionadamente en personas reales?

El equipo de investigación de Stanford y DeepMind reconoce estos riesgos. Su marco requiere un consentimiento claro de los participantes y les permite retirar sus datos, tratando la replicación de la personalidad con las mismas preocupaciones de privacidad que la información médica confidencial.

Esto al menos proporciona cierta protección teórica contra formas más maliciosas de uso indebido. Pero, en En cualquier caso, nos estamos adentrando cada vez más en territorios inexplorados de la interacción hombre-máquina, y las implicaciones a largo plazo siguen siendo en gran medida desconocidas.